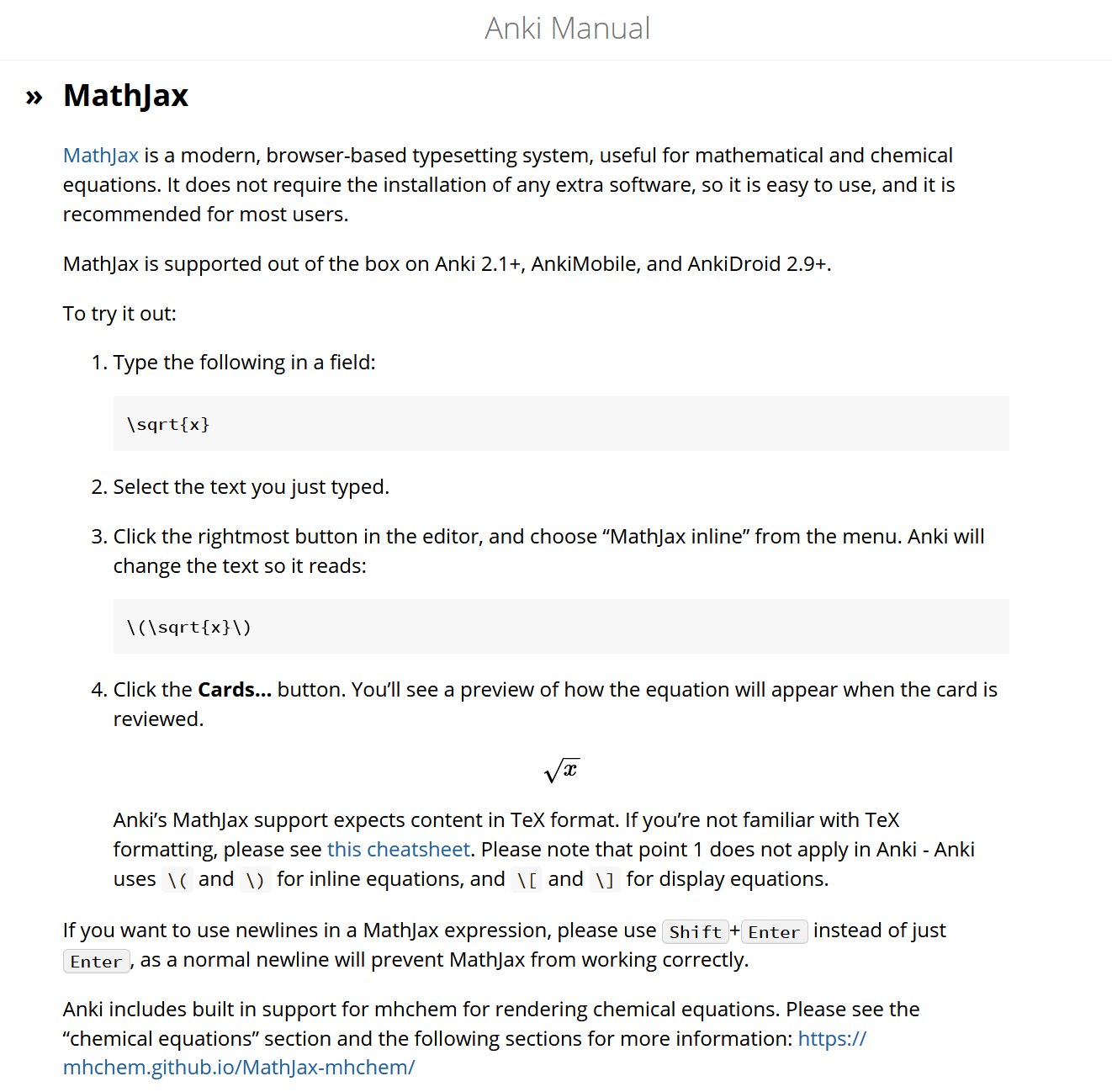

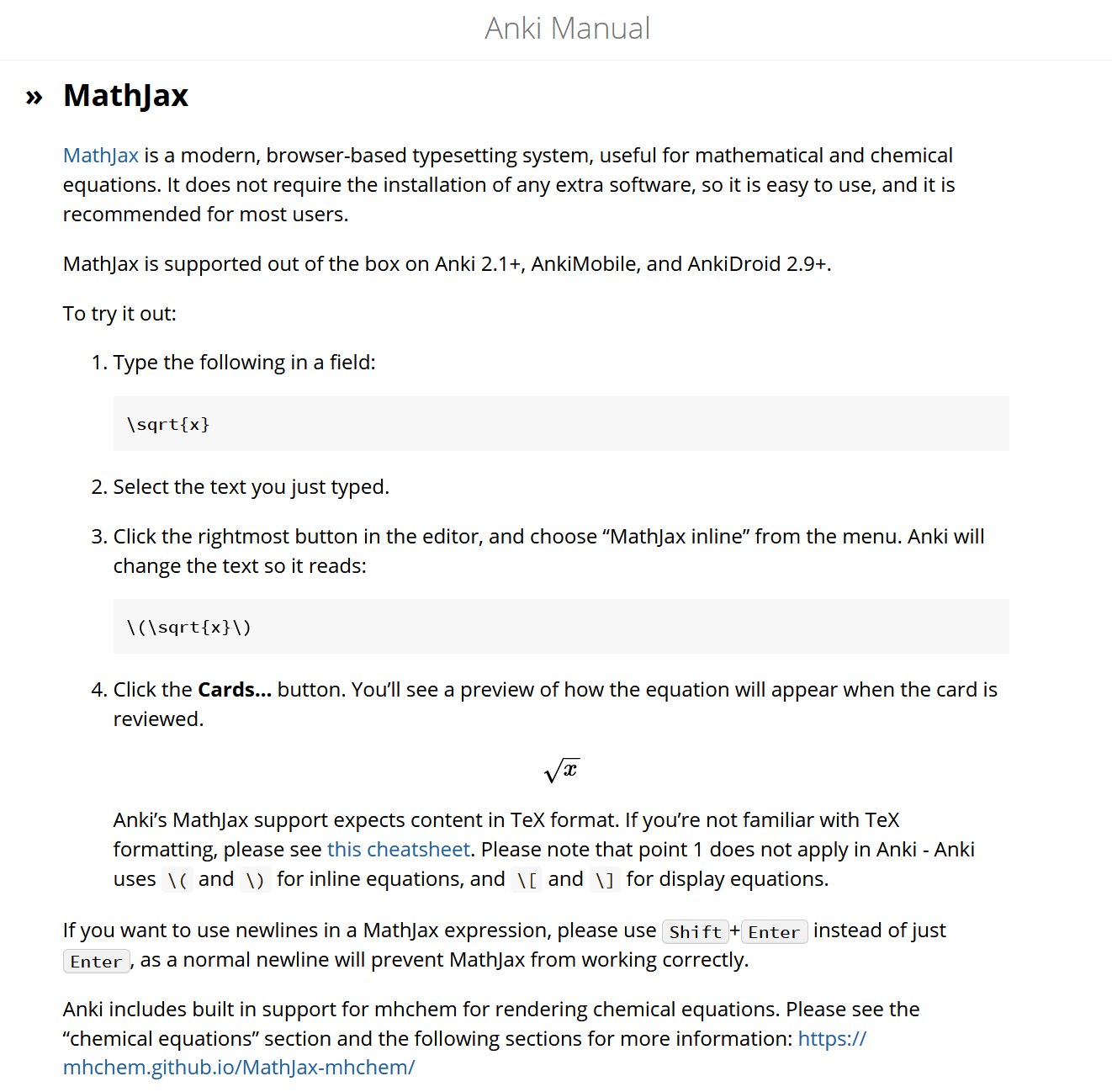

Anki支持数学公式,使用MathJax语法渲染,与LLM回答输出中包含的Latex通用,但存在包裹符号的使用习惯问题。

LLM输出的公式往往使用$包裹,但Anki Manual指定\(或\[ 标识数学公式。

本工具可将LLM输出的原始Markdown中的公式批量转换为Anki支持语法,且区分了行间公式和行内公式。

Beautiful and accessible math in all browsers-MathJax

Anki支持数学公式,使用MathJax语法渲染,与LLM回答输出中包含的Latex通用,但存在包裹符号的使用习惯问题。

LLM输出的公式往往使用$包裹,但Anki Manual指定\(或\[ 标识数学公式。

本工具可将LLM输出的原始Markdown中的公式批量转换为Anki支持语法,且区分了行间公式和行内公式。

Beautiful and accessible math in all browsers-MathJax

但是,草台班子上的一片瓦

掉下来能把人砸出脑溢血。